Ideengeschichte des Privacy by Design – Teil 2: Brückenbauer zwischen Informatik und Recht

23.08.2016

![]() [IITR – 23.8.16] Mitte der 90er Jahre gab es auf technischer Basis zunächst nichts, was die Kernprinzipien des Datenschutzes funktional zufriedenstellend umgesetzt hätte. In Deutschland gab es zwar einen Maßnahmenkatalog, mit dem die Datenschutzbehörden bestimmte „technische und organisatorische Maßnahmen“ einfordern konnten. Da dieser jedoch nicht dem wissenschaftlichen Stand entsprechend aktualisiert und erweitert wurde, wie der Informatikhistoriker Jörg Pohle dokumentierte, verstand man den Datenschutz zunehmend als eine Angelegenheit, die man vornehmlich juristisch regeln konnte. Ähnlich war es zunächst auch in den Niederlanden. Doch das war kein Grund für John Borking, das technisch Gegebene einfach zu akzeptieren.

[IITR – 23.8.16] Mitte der 90er Jahre gab es auf technischer Basis zunächst nichts, was die Kernprinzipien des Datenschutzes funktional zufriedenstellend umgesetzt hätte. In Deutschland gab es zwar einen Maßnahmenkatalog, mit dem die Datenschutzbehörden bestimmte „technische und organisatorische Maßnahmen“ einfordern konnten. Da dieser jedoch nicht dem wissenschaftlichen Stand entsprechend aktualisiert und erweitert wurde, wie der Informatikhistoriker Jörg Pohle dokumentierte, verstand man den Datenschutz zunehmend als eine Angelegenheit, die man vornehmlich juristisch regeln konnte. Ähnlich war es zunächst auch in den Niederlanden. Doch das war kein Grund für John Borking, das technisch Gegebene einfach zu akzeptieren.

Das erste PET-System

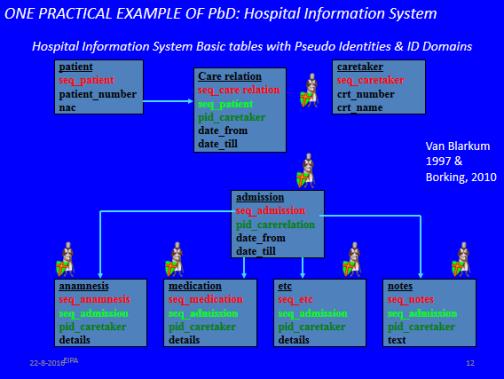

1996 führte die niederländische Datenschutzbehörde ein Datenschutz-Audit in einer psychiatrischen Klinik durch und fand dabei schwere, aber unabsichtlich entstandene Fehler. Das Management war darüber nicht glücklich und stimmte mit den Datenschützern darüber ein, dass eine technische Lösung gefunden werden musste. Borking: „Wir verlangten ein IT-System, das die Datenschutz-Prinzipien aufnimmt. Die Frage war nur, wer das bauen kann.“

Auf dem Markt gab es keine Lösung. Aber es gab eine theoretische Basis von David Chaum. Mit dem Utrechter Firma SIAC, einer niederländischen Niederlassung von ICL, fand man einen Partner, der die Vorgaben bereits ein Jahr später umsetzte. Ein Vorgang, der bis heute nahezu unerhört ist.

Nach dem euphorischen Anfang passierte aber mangels leicht verfügbarer Techniken nicht mehr viel. „Wir waren der Zeit mindestens um 20 Jahre voraus“, sagt Borking heute, der eine so lange Durststrecke nicht erwartet hatte.

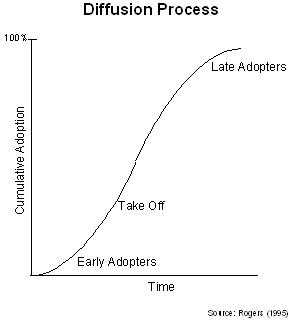

Das Problem war, dass der Markt für „Privacy Enhancing Technologies“ (PETs) erst einmal reif sein, die Innovation adoptieren musste. Borking: „Ich bin ein Anwalt mit IT-Interesse und etwas technischem Hintergrund – ich wusste nichts über Technologiezyklen. Aber als ich die S-Kurve, mit der Everett Rogers die diese Zyklen beschreibt, Jahre später zum ersten Mal sah, hat mich das getröstet.“ Denn sie zeigt, dass wenn die Nutzer eine Innovation nicht sofort annehmen, es eine lange Zeit dauern kann, bis sie sich tatsächlich auf dem Markt durchsetzt.

Erst drei Jahre nach Kopenhagen griffen die Datenschutzbehörden auf einer Konferenz in Wien Borkings Idee auf und zeigten sich darüber einig, dass man in Richtung PET gehen müsse.

Eine Datenschutz-Aufsichtsbehörde begibt sich in die Forschung

Die weiteren wesentlichen Schritte passierten dann aber nicht auf der gesetzgeberischen Seite, sondern auf der Forschungsseite: 1999 kamen die PETs in der EU-Kommission an, als Andrea Servida, Mitarbeiter der Generaldirektion Infosoc, die Förderung des Projekts PISA (Privacy Incorporated Software Agent) ermöglichte. Im Rahmen des Projekts traf Borking 2000 auch erstmals den Informatikprofessor Andreas Pfitzmann, der zu dieser Zeit bereits mit Bäumlers Behörde zusammenarbeitete. Später gab es im Rahmen der europäischen Forschungsrahmenprogramme zahlreiche weitere wichtige Projekte wie PRIME.

In PRIME griffen die schleswig-holsteinischen Datenschützer Borkings Ideen auf. Bäumler hatte Borking 1995 ermuntert diese in der deutschen Datenschutzzeitschrift DUD vorzustellen. Der “Identity Protector” gilt heute als das erste internationale Konzept, Prinzipien des Datenschutzes technisch zu implementieren und damit ethische Prinzipien in der Informationstechnik umzusetzen. Dabei geht es darum, dass Menschen nicht an jeder Stelle für jeden Zweck ihre Identität offenlegen müssen, damit es nicht zu verkettbaren Personenprofilen kommt.

Borking traf die Informatikerin Marit Hansen erstmals 1997 in Kiel. Hansen hatte sich nach ihrem Studium bei Bäumler beworben. Sie kannte ihn aus ihrer Studienzeit, da die Informatik-Fachschaft der Universität Kiel ihn für ein Vorlesungsprojekt hatte gewinnen können. Bäumler erinnert sich: „Sie saß damals mit Kristian Köhntopp und den Fachschaftsvertretern in der ersten Reihe und brachte sich vernehmlich in die Diskussion ein.“

Borkings und Hansens erstes gemeinsames Projekt befasste sich mit Biometrie, zumal Borking gerade einen Technologiefolgenabschätzungsbericht zur Biometrie veröffentlicht hatte, der sich damit beschäftigte, wie PET-Techniken die Gefahren für den Datenschutz durch Biometrie dämpfen könnten. Später griff Hansen in den EU-Projekten PRIME, PrimeLife und ABC4Trust Borkings Konzept vom „Identity Protector“ auf, das somit Pate für die “attributbasierten Berechtigungsnachweise” stand. Es erreichte Anfang 2015 nach vielen Millionen Euro Fördergeldern endlich Praxisreife.

Die ABCs

Bei den „attributbasierten Berechtigungsnachweisen“ (ABCs) geht es darum, dass Nutzer in einer Kommunikationsumgebung sich nicht mit ihrem Namen, sondern bestimmten Eigenschaften ausweisen können. Abgefragt wird also nur die Eigenschaft, die für die jeweilige Fragestellung relevant ist. So etwa die Tatsache, ob jemand älter als 18 Jahre alt ist oder ob er eingeschriebener Student ist. Für verschiedene Zeit- und Kommunikationsräume kann ein Anwender in ein und derselben Anwendung verschiedene Pseudonyme verwenden. Auf diese Weise ist es nicht möglich, das Verhalten eines bestimmten Pseudonyms auszuwerten und daraus ein Persönlichkeitsprofil zu entwickeln. Die „attributbasierten Berechtigungsnachweise“ erfüllen damit das Datenschutzziel der Nicht-Verkettbarkeit.

Darüber hinaus gibt es die Inspektor-Funktion. So ist es dem Betreiber der Anwendung möglich, die Identität eines Anwenders zu enthüllen, wenn dieser etwa Straftaten begangen hat. Über diese Aufdeckungsmöglichkeit muss der Nutzer aber bereits im Vorfeld informiert werden. Eine rückwirkende Aufdeckung ist nicht möglich. Schaltet der Betreiber aber für einen Kommunikationsbereich auf „Aufdeckbarkeit“ um, muss der Nutzer darüber informiert werden. So weiß er in jedem Fall, in welcher Art von Kommunikationsumgebung er sich bewegt. Der Unterschied zu den heutigen Systemen besteht darin, dass der Betreiber ohne Mehraufwand diese Entscheidung treffen kann.

Das besondere an den „attributbasierten Berechtigungsnachweisen“ ist also, dass sie zwar Anonymität ermöglichen, aber auch deren kontrollierte Aufdeckung. Anonymität im Netz hat bei vielen Dienste-Betreibern einen schlechten Beigeschmack, da sie für illegale Aktivitäten missbraucht werden kann. Deshalb ist sie etwas, was Strafverfolger und Geheimdienste unbedingt verhindern wollen. Die meisten Dienste-Betreiber setzen ihre Systeme deshalb bewusst so auf, dass sie nicht in Konflikt mit dem Gesetz geraten. Doch datensparsam im Sinne des Datenschutzrechts sind sie wiederum auch nicht.

Wird Anonymität aber kontrolliert und transparent aufdeckbar, gehen die Nutzer mit ihr verantwortungsvoller um. „Die Idee ist, dass die Leute lernen, mit Anonymität umzugehen“, meint Kai Rannenberg von der Johann-Wolfgang-Goethe-Universität Frankfurt. Für Marit Hansen sind die „attributbasierten Berechtigungsnachweise“ ein Identitätsmanagement-Konzept, die den Geist des Datenschutzes praktisch atmen.

Alle Dienste, die ein persönliches Einloggen verlangen, könnten künftig ganz anders aussehen. Bis es so weit ist, werden wohl noch weitere Pilotprojekte notwendig sein. Denn die Pilotprojekte setzen auf Smartcard-Systeme auf. Ein nächster möglicher Schritt wäre etwa die Verknüpfung mit dem neuen Personalausweis, der auch die Verwendung von Pseudonymen unterstützt. Eventuell könnte man künftig dann anonym sein Elektroauto mit dem Perso aufladen. Davon ist die gegenwärtige Diskussion um Ladesäulen aber Meilen entfernt.

Ein weiterer Schritt wäre die Verbindung mit Bezahlsystemen. So könnte man das umstrittene Kredit-Scoring völlig neugestalten. Der Nutzer eines Dienstes könnte einen Bezahldienst verwenden, ohne dass der Dienste-Anbieter den Namen seines Kunden erfährt. Im Prinzip lässt sich damit jeder nutzer-orientierte Dienst neugestalten: Auch soziale Netzwerke wie Facebook und Google Plus.

Brückenbauer zwischen Informatik und Recht

Ohne die Informatikerin und heutige Leiterin des Kieler Unabhängigen Landeszentrums für Datenschutz (ULD) Marit Hansen wäre Borkings Idee wahrscheinlich noch immer nicht verwirklicht worden. Wie über Borking gab es bis 2015 über Hansen kaum personenbezogene Daten, weil sie lieber wie viele ihrer Kollegen im Hintergrund arbeitete. Auf der ULD-Website hatte sie bis kurz vor ihrer Wahl zur Nachfolgerin von Thilo Weichert nicht einmal eine eigene Profilseite. Die Pressefotos, die man nur auf Anfrage erhalten konnte, waren mehrere Jahre alt. Dafür war und ist sie aber in den Fußnoten der einschlägigen Forschungsliteratur sehr präsent. Wenig überraschend ist auch, dass sie zu den Autoren des ENISA-Berichts gehört, der den „Stand der Technik“ von Privacy by Design beschreibt. Seit ihrem Karrieresprung im vergangenen Jahr hat sich das aber geändert.

Wie Borking ist Marit Hansen jemand, der die Welt des Rechts und die Welt der Informatik gleichermaßen versteht. Und typisch für diese Art von Brückenbauern ist auch, dass sie in dem jeweiligen Gebiet zwar nicht die höchsten akademische Weihen haben oder den höchsten administrativen Rang einnehmen, aber aufgrund ihrer Präsenz in zwei Welten über hohes „soziales Kapital“ und damit über enormen Einfluss verfügen.

Borking sagt über Hansen: „Sie ist diejenige, die der Gemeinschaft der Datenschutzaufsichtsbehörden nicht nur eine kompetente, sondern auch freimütige Stimme in Sachen PETs und Privacy by Design verleiht.“ Und Michael Waidner, Leiter des Fraunhofer-Instituts für Sichere Informationstechnologie und Inhaber der Professur “Sicherheit in der Informationstechnik” an der TU Darmstadt, hält sie für „extrem kompetent in beiden Welten“: „Was sie sagt, hat Hand und Fuß. Ich verlasse mich auf ihre Meinung.“

Wie aber kam Marit Hansen auf das Thema? Andreas Pfitzmann drückte ihr nach einer Podiumsdiskussion Anfang der 90er Jahre eine Kopie seiner Veröffentlichung zu ISDN-Mixes in die Hand. Hansen erinnert sich: „Andreas Pfitzmann war zu der Zeit junger Wissenschaftler, Post-Doc, Dozent an der Uni Hildesheim oder möglicherweise schon Professor an der TU Dresden. In der Podiumsdiskussion hatte er mich beeindruckt, weil er sehr klar und gleichzeitig sehr ruhig in einer emotionalen Diskussion über innere Sicherheit seine Argumente vorbrachte, was in deutlicher Diskrepanz zu den anderen Beiträgen stand, die hauptsächlich aus politischen Worthülsen oder Parolen bestanden. Ich sprach ihn anschließend darauf an, er musste aber ganz schnell zum Zug laufen. Statt Aktentasche oder Koffer mit dunklem Mantel, wie die anderen Vortragenden ausgestattet waren, hatte er wie immer einen Rucksack auf und wirkte wie ein Student. Er hielt kurz inne, freute sich über das Interesse und holte aus dem Rucksack das Papier heraus.“

Hansen war überrascht, denn „ich hatte nicht erwartet, einen Sonderdruck einer wissenschaftlichen Veröffentlichung zu einem ganz anderen Thema als der Podiumsdiskussion in die Hand gedrückt zu bekommen: ISDN-Mixe waren damals der Versuch von Pfitzmann & Co., im ISDN-Telefonnetz Anonymisierungssysteme in der Infrastruktur einzubauen, und die Arbeit zeigte, dass dies zumindest theoretisch ging. Zu der Zeit war ich noch im Studium und kannte Chaum oder Datenschutztechnikideen nicht. Dieses sehr spezielle Papier mit einem eher unattraktiven Titel, so fand ich damals, war also das erste, was ich zu Privacy by Design im wissenschaftlichen Bereich erfuhr. Dass dieses Thema für mein Berufsleben bestimmend werden sollte, wusste ich zu dem Zeitpunkt noch nicht – damals wirkte dieser Artikel wie eine Kuriosität.“

Seitdem Helmut Bäumler das ULD 2004 verlassen hat, ist Hansen nach Borkings Beobachtung der Antrieb für eine kontinuierliche, technologische Forschung zum Schutz der Privatsphäre. Doch noch immer ist bis heute das ULD die einzige Datenschutzaufsichtsbehörde in Europa, die bei der Entwicklung von Datenschutztechniken in Forschungsprojekten einen aktiven Part einnimmt. „Marit Hansen müsste man drei Mal klonen“, sagt etwa der im Frühjahr in Rente gegangene ehemalige baden-württembergische Landesdatenschützer Jörg Klingbeil.

Privacy by Design ist leider keine Bilderbuchgeschichte

Würde diese Schilderung hier enden, wäre die Geschichte der PETs relativ reibungslos vonstattengegangen. Dieser Eindruck entsteht oftmals dann, wenn man versucht eine vergleichsweise kleine, nichts desto weniger bedeutsame Facette des Datenschutzes wie „Privacy by Design“ durch ein Nadelöhr namens Zeitstrahl zu pressen. Doch zwischenzeitlich gab es viele weitere Projekte und Hoffnungen, überraschende Wendungen und herbe Enttäuschungen. Niemand konnte wissen, ob und wie sich die Idee durchsetzen würde, da allzu viele Ideen gescheitert oder sich eine ganz andere Richtung entwickelt hatten. Immer wieder mussten die Akteure mit Durststrecken und Zurückweisungen kämpfen. Mehr dazu demnächst in Teil 3 dieser Serie.

- Teil 1: Die Hand im Bienenstock

- Teil 3: Entwicklungswege

- Teil 4: Wege in die Gestaltung

- Teil 5: Die Zurückeroberung der Nutzersouveränität

- Teil 6: Die Operationalisierung des Datenschutzrechts

- Teil 7: Herausforderungen erkennen und gestalten

Autorin:

Christiane Schulzki-Haddouti

Information bei neuen Entwicklungen im Datenschutz

Tragen Sie sich einfach in unseren Newsletter ein und wir informieren Sie über aktuelle Entwicklungen im Datenschutzrecht.